随着数字化转型的深入,混合云因其灵活性、成本效益和对业务需求的快速响应能力,已成为众多企业的首选IT架构。将数据分布在本地数据中心、私有云和多个公有云之间,也带来了前所未有的管理复杂性、安全风险与合规挑战。作为企业管理咨询顾问,我们观察到,成功驾驭混合云数据浪潮的企业,普遍遵循以下四大核心最佳实践。

实践一:构建统一的数据治理与安全策略

混合云环境的首要挑战是数据的“碎片化”。最佳实践要求企业首先建立一个跨所有云环境和本地系统的、统一且一致的数据治理框架。这包括:

- 集中化策略管理:定义数据的分类分级标准、访问权限策略(基于角色的访问控制RBAC)、加密标准以及数据生命周期管理策略,并确保这些策略在所有部署环境中自动、一致地执行。

- 零信任安全模型:贯彻“从不信任,始终验证”的原则。无论数据位于何处,对所有访问请求都进行严格的身份验证、设备健康检查和最小权限授权。利用云服务商提供的原生安全工具及第三方解决方案,实现持续的威胁监测与响应。

- 合规性自动化:明确数据主权和 residency 要求(如GDPR、数据安全法等)。利用策略驱动的自动化工具,确保数据在创建、存储、流动和处理的全过程中始终符合相关法律法规与行业标准。

实践二:实现数据的可观测性与智能运维

“看不见,则无法管理。” 企业需要建立对混合云数据流的全景式可观测能力。

- 统一监控仪表盘:整合来自不同云平台和本地系统的监控日志与指标,构建一个集中的、可视化的数据运维仪表盘。实时掌握数据的性能、健康状况、成本消耗及安全事件。

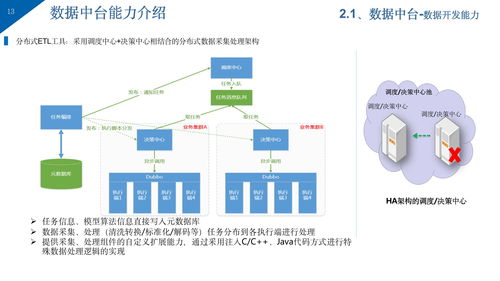

- 元数据管理与数据目录:建立企业级数据目录,自动采集和管理跨环境的元数据。这使数据科学家、分析师和业务用户能够轻松发现、理解并信任所需的数据资产,提升数据利用效率,减少“数据孤岛”。

- AI驱动的智能运维:应用机器学习和人工智能技术,对海量运维数据进行分析,实现异常检测的预测性预警、根因分析的自动化以及部分修复操作的自主执行,从而提升运维效率,保障数据服务的SLA。

实践三:优化数据移动与集成架构

混合云的核心价值在于让数据和工作负载在其最适合的环境中运行。这要求高效、可靠且安全的数据移动能力。

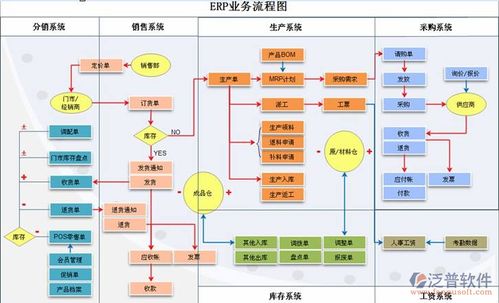

- 设计高效的数据流水线:根据数据的延迟敏感性、吞吐量要求和成本,选择合适的数据同步与集成工具(如ETL/ELT工具、变更数据捕获CDC、消息队列等)。对于实时分析场景,可考虑建立流数据处理管道。

- 最小化不必要的数据迁移:遵循“计算向数据靠拢”的原则,尽可能在数据所在地进行计算和分析,避免大规模、频繁的原始数据跨云迁移,以节省网络带宽成本和降低延迟。

- 标准化接口与API管理:采用微服务架构和标准化的API(如RESTful API)来封装和暴露数据服务。这确保了不同云间应用与数据交互的松耦合与灵活性,便于未来架构的演进。

实践四:实施精细化的成本管理与价值评估

混合云的成本模型复杂多变,容易产生不可预见的支出。卓越的数据管理必须与财务管理紧密结合。

- 数据存储与访问的成本标签化:为所有数据资产打上业务部门、项目、环境等成本标签。利用云成本管理工具,清晰追溯和分摊数据存储、访问、计算和分析所产生的费用。

- 基于策略的自动化成本优化:制定自动化策略,例如将不常访问的“冷数据”自动迁移至成本更低的存储层级(如对象存储的归档层),或自动关闭非生产环境在非工作时段的计算资源。

- 建立数据价值评估体系:超越成本视角,建立衡量数据业务价值的指标体系。将数据管理投入与数据驱动的业务成果(如客户洞察带来的收入增长、预测性维护降低的运营成本等)相关联,确保数据投资回报率(ROI)最大化。

在混合云中管理数据,绝非简单的技术工具堆砌,而是一项需要战略规划、持续优化和跨部门协作的系统工程。上述四大实践——统一的治理、全景的可观测、高效的移动和精细的成本控制——构成了一个稳固的支柱体系。企业应从自身业务目标和数据现状出发,循序渐进地推进这些实践,并持续培养团队相应的技能与文化。唯有如此,才能将混合云的数据复杂性转化为驱动业务创新与增长的强大动能,在数字经济的竞争中赢得先机。